Des modèles Open Source pour innover efficacement avec l'IA

Simplifiez l'IA générative dans l'ensemble de l'entreprise

Dans tous les secteurs, l'intelligence artificielle (IA) générative continue de transformer la manière dont les entreprises gèrent leur exploitation, prennent des décisions et proposent des solutions innovantes.

Qu'il s'agisse de personnaliser les expériences client, d'automatiser la création de contenus ou d'améliorer la prise de décisions, l'IA générative aide les entreprises à rationaliser les processus, à augmenter la productivité et à explorer de nouvelles possibilités. En investissant dans des solutions d'IA innovantes, ces entreprises renforcent leur capacité à gérer la complexité, à répondre aux évolutions de la demande et à atteindre leurs objectifs stratégiques.

Pour nombre d'entre elles, il est néanmoins difficile d'exploiter tout le potentiel des technologies d'IA générative. En effet, les licences des grands modèles de langage (LLM) propriétaires sont onéreuses, et leur entraînement ainsi que leur inférence demandent des ressources matérielles importantes. En fin de compte, le déploiement et le fonctionnement de ces modèles coûtent cher aux entreprises. L'entraînement et l'ajustement de LLM pour des cas d'utilisation propres à un client ou secteur peuvent s'avérer difficiles lorsque les équipes de développement et les spécialistes du domaine ne disposent pas de l'expertise requise en science des données, et ce, même s'ils connaissent parfaitement les exigences de l'entreprise et des applications. De plus, la présence de données propriétaires et confidentielles dans les environnements de cloud hybride complexes (datacenters privés, ressources de cloud public ou encore déploiements à la périphérie du réseau) complique l'entraînement des modèles d'IA générative, en particulier lorsque les exigences réglementaires limitent les mouvements des données.

Red Hat propose une approche simplifiée qui rend l'IA générative accessible aux équipes de développement et aux spécialistes du domaine dans toutes les entreprises. Avec la plateforme Red Hat® AI, vous pouvez entraîner et exécuter efficacement des modèles d'IA générative sur des serveurs de production pour accélérer et faciliter l'adoption de l'IA.

80 %des entreprises estiment que l'IA générative transformera leur activité au cours des 18 prochains mois1.

Accélérez l'innovation à l'aide de petits modèles de langage spécialisés

Les LLM sont capables de comprendre et de générer du langage naturel. Cependant, le coût des ressources de calcul requises pour leur entraînement et leur inférence limite souvent leur utilisation dans de nombreuses applications métier. Heureusement, la plupart des entreprises n'ont pas besoin de capacités aussi poussées et les petits modèles de langage (SLM) spécialisés leur conviennent davantage.

Plus petits que les LLM, les SLM nécessitent moins de ressources de calcul, de données et d'énergie. Il s'agit donc de modèles d'IA générative efficaces et économiques pour de nombreuses applications métier. Ils sont plus rapides à entraîner, plus faciles à ajuster et représentent une approche plus durable en matière de développement de modèles d'IA. Grâce à la rationalisation du déploiement et à l'amélioration des performances des applications basées sur l'IA, les SLM aident à réduire les coûts tout en offrant des solutions adaptées et innovantes pour atteindre vos objectifs métier.

Les SLM offrent plusieurs avantages aux entreprises. Leur taille compacte et leurs exigences réduites en matière de données permettent de les personnaliser rapidement et efficacement en fonction de tâches ou de domaines spécifiques. Résultat : des modèles d'IA générative plus précis et moins coûteux. En intégrant directement les connaissances et l'expertise de l'entreprise dans les paramètres pendant l'entraînement, vous pouvez améliorer la pertinence du modèle, limiter les besoins de réentraînement et réduire la durée de développement de vos applications et services essentiels basés sur l'IA. Puisqu'il est possible de les déployer efficacement dans les environnements d'entreprise sur site ou dans le cloud privé, les SLM facilitent la protection des données d'entraînement sensibles et propriétaires, tout en permettant de garder le contrôle sur les accès, de simplifier la conformité réglementaire et de réduire la dépendance vis-à-vis de fournisseurs externes. Dans les environnements aux ressources limitées et à la périphérie du réseau, les SLM permettent d'exécuter les applications en temps réel directement sur les appareils des utilisateurs, ce qui simplifie le développement et élimine le besoin d'une infrastructure cloud externe.

Regardez cette vidéo pour en savoir plus sur les avantages des petits modèles de langage.

Prenez le contrôle à l'aide de solutions d'IA générative Open Source

Le niveau de visibilité, de sécurité et de confidentialité des solutions d'IA commerciales est souvent source d'inquiétudes, tandis que l'incertitude autour des données d'entraînement utilisées et de la précision des réponses fait peser un risque juridique sur les entreprises. Pour surmonter ces défis, le nombre de LLM Open Source augmente. Ces modèles offrent le choix, la liberté et la transparence dont vous avez besoin pour mieux comprendre vos modèles, les personnaliser et assurer leur fiabilité.

Préentraînés par un fournisseur de confiance, les LLM et SLM Open Source incluent des composants logiciels et des pondérations de modèles sous licence Open Source. Ainsi, vous pouvez injecter vos données et votre expertise dans les modèles de base et jeux de données d'entraînement de manière fiable et transparente. Ces modèles permettent également d'éviter tout enfermement propriétaire et vous rendent le contrôle total de vos solutions d'IA. Puisque les fournisseurs de confiance divulguent l'origine des données utilisées pour entraîner les modèles Open Source, vous pouvez évaluer leur qualité et écarter les données biaisées ou préjudiciables avant d'ajouter vos propres données propriétaires et confidentielles. En outre, les pratiques de gouvernance ouvertes aident à identifier et à limiter les biais lors du développement des modèles, ce qui renforce l'équité et la fiabilité des systèmes d'IA.

Enfin, les LLM Open Source distribués sous licence Apache 2.0 offrent la flexibilité nécessaire pour contrôler et personnaliser vos modèles. Ainsi, il est possible d'adapter vos solutions d'IA innovantes à vos besoins métier.

La puissance de l'Open Source dans le domaine de l'IA

Les approches Open Source deviennent un facteur important pour améliorer la fiabilité

des technologies d'IA générative. Découvrez l'influence de l'Open Source dans le domaine de l'IA :

- Lisez cet article de blog pour découvrir comment les communautés Open Source font progresser les technologies d'IA.

- Lisez cet article de blog pour comprendre pourquoi de plus en plus d'entreprises font confiance

aux technologies d'IA Open Source. - Regardez cette vidéo pour découvrir comment vous pouvez contribuer aux initiatives d'IA Open Source.

Rationalisez le développement de l'IA avec Red Hat Enterprise Linux AI

De nombreuses entreprises peinent à créer des solutions d'IA à la fois rentables et adaptées à leurs besoins métier. Red Hat Enterprise Linux® AI offre une plateforme de modèle de fondation stable et cohérente afin d'accélérer et de simplifier le développement et le déploiement de solutions d'IA générative innovantes pour les entreprises.

Grâce à ses fonctions et fonctionnalités avancées pour l'entraînement, le test et l'exécution de SLM spécialisés, Red Hat Enterprise Linux AI vous permet de créer des applications et services d'IA à la fois rentables et personnalisés. Composant clé de la plateforme, la famille Granite de modèles d'IA générative sous licence Open Source (distribuée sous licence Apache 2.0 avec des jeux de données d'entraînement transparents) vous permet de vous lancer plus rapidement dans l'IA générative à l'aide de modèles plus petits et efficaces qui réduisent les coûts d'exploitation sans compromettre les performances. Également inclus dans la plateforme, les outils d'alignement de modèles d'InstructLab simplifient les processus de réglage fin pour rendre l'IA accessible aux équipes de développement et aux spécialistes du domaine. Pour ce faire, ils alignent les modèles sur les données d'entreprise et élargissent l'accès aux modèles d'IA générative développés par la communauté.

Distribuée en tant qu'image de démarrage avec des bibliothèques d'IA répandues telles que PyTorch, ainsi que des accélérateurs optimisés pour le matériel NVIDIA, Intel et AMD, la solution Red Hat Enterprise Linux AI simplifie l'intégration de technologies d'IA essentielles tout en rationalisant l'entraînement et l'inférence de modèles sur des serveurs de production, afin que vous puissiez démarrer vos projets d'IA générative de manière efficace. L'assistance technique pour la production et l'indemnisation pour la propriété intellectuelle des modèles contribuent à réduire les risques. Ainsi, vous pouvez axer sereinement vos efforts sur la création, le déploiement et la gestion de solutions d'IA innovantes en toute transparence et en limitant les coûts.

Adoptez des modèles Open Source Granite pour l'IA d'entreprise

Pour être efficaces, les applications et services d'IA requièrent des modèles capables d'équilibrer les coûts, la transparence et les performances tout en répondant aux exigences des applications d'entreprise. Développée par IBM, la famille de modèles d'IA générative Open Source Granite satisfait ces exigences et s'adapte aux situations métier concrètes. Rentables et efficaces, ces modèles prennent en charge un grand nombre de cas d'utilisation de l'IA générative qui impliquent à la fois du code et du langage. La série de modèles Open Source Granite inclut le modèle Granite 3.0 8b, les modèles Granite 7b en anglais, ainsi que les modèles de code 3b, 8b, 20b et 34b.

Les modèles Granite sont distribués sous licence Apache 2.0, ce qui leur confère une accessibilité Open Source complète. Ces modèles de fondation d'IA sont créés de manière indépendante et ne sont pas issus de modèles propriétaires ou à source fermée. En outre, IBM divulgue les jeux de données et les méthodes utilisées pour l'entraînement, ce qui renforce la transparence et la fiabilité de vos solutions d'IA stratégiques. Consultez le document technique sur les modèles de langage Granite 3.0 pour en savoir plus sur les données d'entraînement et les pratiques d'IBM en matière d'ouverture et de responsabilité.

Entièrement indemnisés par Red Hat, les modèles de code et de langage Open Source Granite permettent aux entreprises de développer et de déployer des applications d'IA sur mesure. En associant les modèles innovants d'IBM à la fiabilité et à l'assistance des plateformes de Red Hat, vous pouvez facilement adopter des solutions d'IA générative Open Source pour relever les défis métier tout en atténuant les risques au sein de votre entreprise.

Regardez cette vidéo pour en savoir plus sur la série de modèles Open Source Granite.

Démocratisez le développement de l'IA avec InstructLab

L'adaptation des modèles d'IA générative aux besoins métier d'une entreprise peut devenir une tâche complexe et chronophage, notamment lorsque les ressources et l'expertise sont limitées. Les outils d'alignement de modèles d'InstructLab permettent de personnaliser les modèles d'IA générative à l'aide de connaissances et de compétences spécialisées. Basé sur la technologie Large-Scale Alignment for ChatBots (LAB), le projet InstructLab utilise une approche basée sur la classification pour générer et entraîner des modèles à l'aide de données synthétiques de haute qualité. Celle-ci réduit considérablement la quantité de ressources de calcul et d'informations générées par l'homme habituellement nécessaires pour réentraîner un modèle d'IA.

InstructLab simplifie l'entraînement et le réglage fin, et permet à un plus grand nombre de contributeurs de participer au développement de modèles d'IA générative, notamment les équipes de développement et les spécialistes du domaine qui disposent d'une expérience limitée en matière de science des données. Ce projet favorise ainsi la collaboration entre les équipes techniques et les parties prenantes au sein de l'entreprise pour que les applications et services d'IA soient en phase avec les besoins réels. La démocratisation de l'alignement de modèles d'IA réduit le délai de rentabilisation et aide les entreprises à perfectionner leurs modèles pour atteindre plus efficacement leurs objectifs métier. Ainsi, vous pouvez adapter vos modèles d'IA générative à vos objectifs stratégiques et d'exploitation, et améliorer la précision et la pertinence de vos solutions d'IA les plus importantes. Grâce à l'intégration efficace et peu coûteuse des connaissances de l'entreprise, InstructLab vous permet de générer plus rapidement des résultats et de bénéficier d'un meilleur retour sur vos investissements en matière d'IA.

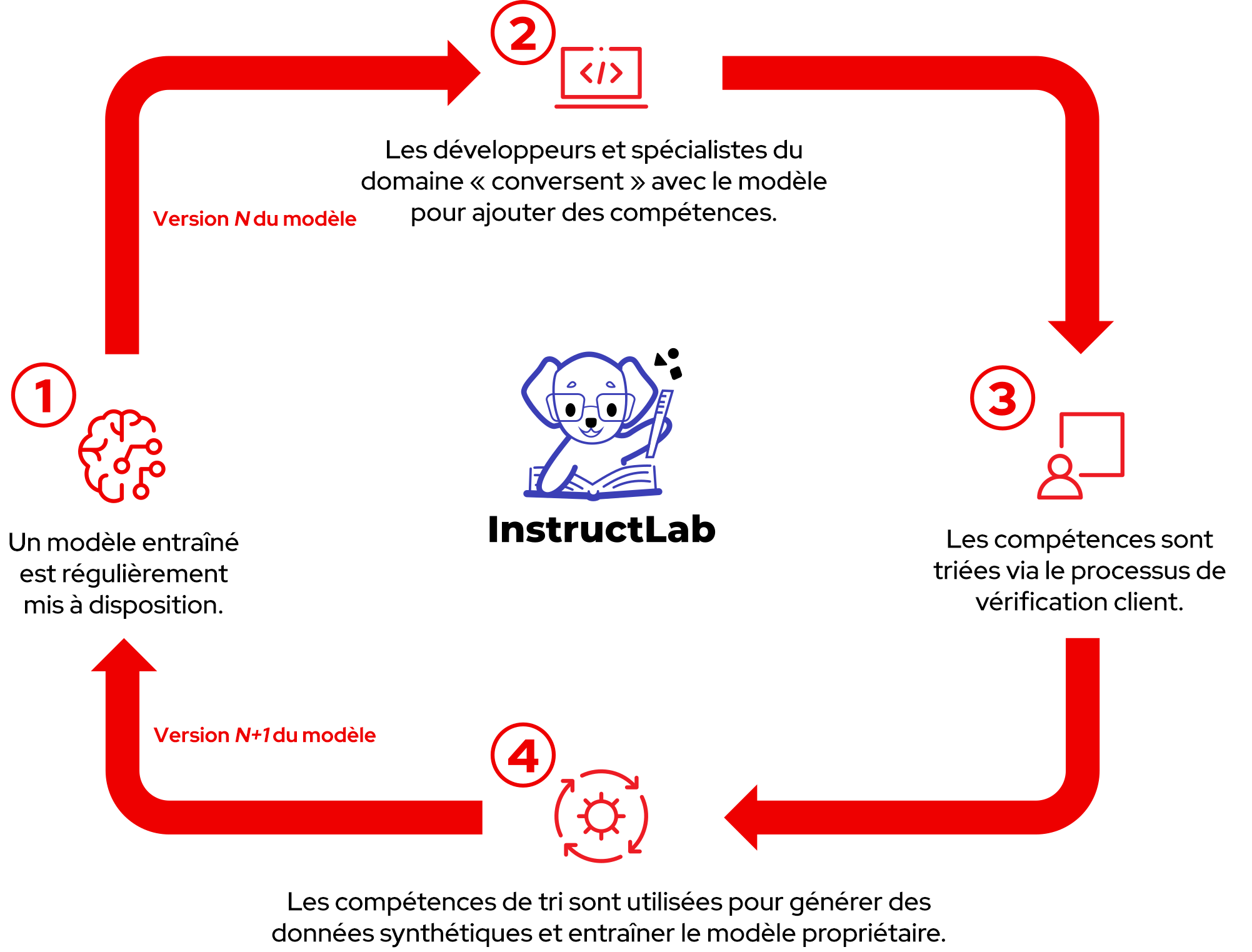

Le projet InstructLab repose sur une approche itérative pour effectuer le réglage fin de modèles d'IA générative. Il encourage la collaboration en permettant aux équipes d'apporter leur expertise, tandis que les spécialistes du domaine valident et approuvent les différentes contributions. Ce processus garantit la transparence et la pertinence de vos modèles à mesure qu'ils évoluent, tout en éliminant les éventuels biais.

Regardez cette vidéo pour en savoir plus sur l'entraînement de modèles d'IA générative avec InstructLab.

Déployez une base solide pour innover avec l'IA

Quel que soit votre niveau d'adoption de l'IA, la plateforme Red Hat Enterprise Linux AI offre le degré de cohérence, de fiabilité et d'innovation requis pour réussir. Avec une base d'exploitation Open Source fiable et des technologies d'IA intégrées, vous pouvez vous lancer plus facilement dans vos projets d'IA et accélérer la concrétisation de vos idées.

Apprenez-en plus sur Red Hat Enterprise Linux AI.

Essayez Red Hat Enterprise Linux AI gratuitement pendant 60 jours

Profitez d'une souscription autogérée et de ressources gratuites pendant 60 jours pour découvrir comment votre entreprise peut développer, entraîner, tester et exécuter la famille de modèles d'IA générative Granite pour les applications d'entreprise.

Démarrez plus rapidement avec les conseils de spécialistes

Collaborez avec nos spécialistes pour planifier et créer des solutions d'IA qui fournissent des résultats métier concrets. Que vous lanciez votre premier projet d'IA générative ou que vous cherchiez à développer vos capacités actuelles, les Services Red Hat peuvent vous aider.

Livre numérique d'IDC, « Are You Ready for AI Everywhere? », 2024